AI skader vore hjerner: Stop op og tænk?

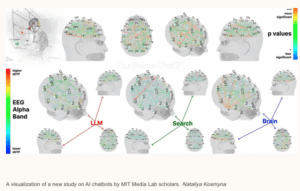

Et stort forskerhold fra MIT har undersøgt en gruppe elevers hjerner mens de skrev en stil. En gruppe brugte en LLM, Large Lanquage Model=en AI fra chatGPT, en anden måtte søge på Google og de sidste skrev uden hjælp.

Undersøgelsen delte 54 forsøgspersoner – 18 til 39-årige fra Boston-området – op i tre grupper og bad dem om at skrive adskillige ‘SAT-essay’s, det der svarer til en dansk stil i gymnasiet.

Forskerne brugte en EEG(hjernescanner) til at registrere forfatternes hjerneaktivitet og de fandt ud af, at af de tre grupper havde ChatGPT-brugere den laveste hjerneaktivitet og “konsekvent underpræsterede på neurale, sproglige og adfærdsmæssige niveauer.”

Copy/Paste

I løbet af nogle måneder blev ChatGPT-brugerne mere og mere dovne efter hvert essay. De tyede ofte til ren copy/paste fra chatGPT. Undersøgelsen mere end antyder, at brugen af LLM’er faktisk kan skade læring, især for yngre brugere.

Kognitiv gæld

Og så har folkene bag opfundet et godt nyt udtryk: “Kognitiv gæld”. Det er noget, der opbygges, når man bruger systemer som AI til at erstatte processer i hjernen, man selv har gjort før, som brugte man pludselig en protese, selvom det ikke er nødvendigt. Og når man gør det, ja så mister man faktisk noget af evnen til selvstændig tænkning, på samme måde som ens ben visner, hvis man sætter sig permanent i en kørestol uden at være handicappet: “When individuals fail to critically engage with a subject, their writing might become biased and superficial. This pattern reflects the accumulation of cognitive debt, a condition in which repeated reliance on external systems like LLMs replaces the effortful cognitive processes required for independent thinking.”

Men det bliver faktisk værre endnu efterhånden som den kognitive gæld vokser: Når din evne til selvstændig tænkning falder, er du også nemmere at manipulere og mindre kreativ.

“Cognitive debt defers mental effort in the short term but results in long-term costs, such as diminished critical inquiry, increased vulnerability to manipulation, decreased creativity. When participants reproduce suggestions without evaluating their accuracy or relevance, they not only forfeit ownership of the ideas but also risk internalizing shallow or biased perspectives”.

Børnehave på AI?

Undersøgelsen er endnu ikke blevet fagfællebedømt, og dens stikprøvestørrelse er relativt lille. Men artiklens hovedforfatter, Nataliya Kosmyna, mente, at det var vigtigt at offentliggøre resultaterne fordi hun er bekymret for et samfund, der i stigende grad er afhængig af LLM’er for umiddelbar bekvemmelighed og hvor børn og unges langsigtede hjerneudvikling bliver ofret undervejs.

“Jeg er bekymret for, at en eller anden politiker i løbet af det næste halve år bestemmer sig til, at ‘vi skal lave chatGPT-børnehaver’. Det ville være virkelig slemt og skadeligt! Hjerner der udvikler sig, løber de største risici ved brug af AI”, sagde Nataliya Kosmyna til Time.Og så er der det etiske:

‘Regarding ethical considerations, participants who were in the Brain-only group reported higher satisfaction and demonstrated higher brain connectivity, compared to other groups. Essays written with the help of LLM carried a lesser significance or value to the participants, as they spent less time on writing, and mostly failed to provide a quote from theis essays.Human teachers “closed the loop” by detecting the LLM-generated essays, as they recognized the conventional structure and homogeneity of the delivered points for each essay within the topic and group.We believe that the longitudinal studies are needed in order to understand the long-term impact of the LLMs on the human brain, before LLMs are recognized as something that is net positive for the humans’

Link til undersøgelsen: https://arxiv.org/pdf/2506.08872v1